مقالات

روان شناسی

روان شناسی تربیتی

روان شناسی کودک

روان شناسی نوجوانان

۹ شهریور ۱۴۰۴

زمان خواندن: ۵ دقیقه

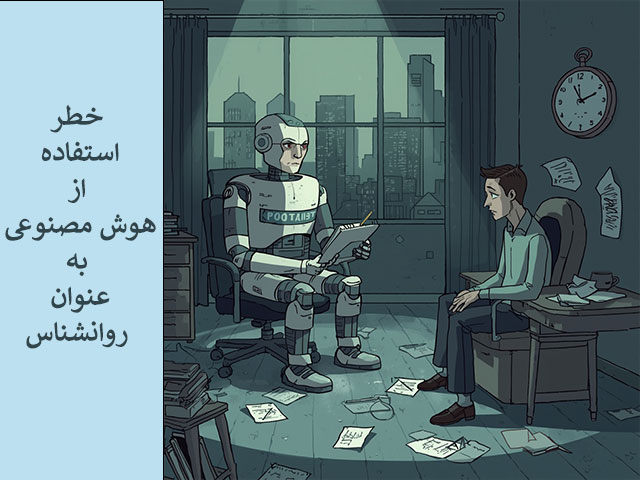

خطر استفاده از هوش مصنوعی به عنوان روانشناس

دیدگاهها ۲